La présente publication a été préparée dans le cadre d’une série visant à appuyer les parlementaires au commencement de la 43e législature. Elle fait partie du programme des publications de recherche de la Bibliothèque du Parlement, qui comprend notamment un ensemble de publications, lancées en mars 2020, sur la pandémie de la COVID 19. Veuillez noter qu’en raison de la pandémie, toutes les publications de la Bibliothèque seront diffusées en fonction du temps et des ressources disponibles.

Il n’existe pas de définition universellement acceptée du terme « système d’armes autonome » (on dit aussi parfois « système d’armes létal autonome ») 1, mais l’expression désigne en général un système d’armes présentant deux caractéristiques : il peut fonctionner sans intervention humaine, et il peut sélectionner et attaquer des cibles de son propre chef, en suivant des algorithmes prédéfinis. Un système de ce type constitue une application avancée de l’« apprentissage profond », qui est une forme d’intelligence artificielle 2. L’apprentissage profond permet à certaines machines de créer leurs propres algorithmes après avoir été exposées à des quantités énormes de données, et de prendre des décisions fondées sur ces algorithmes.

Le présent document analyse quelques répercussions des systèmes d’armes autonomes sur la sécurité internationale et sur le Canada. Il traite tout particulièrement de la définition du concept d’autonomie dans le contexte des systèmes d’armes, et donne un aperçu de l’avancement des technologies connexes. Il présente ensuite les avantages potentiels des systèmes d’armes autonomes ainsi que certains problèmes qu’ils pourraient entraîner pour la sécurité internationale. Enfin, il décrit la campagne internationale visant à interdire ces systèmes ainsi que l’approche adoptée par le Canada à ce sujet.

Les systèmes d’armes autonomes sont de formes et de tailles diverses. Ils peuvent être utilisés dans les airs, en mer 3 et sur terre 4. En outre, ils peuvent fonctionner seuls ou « en essaim ». Un essaim est un ensemble coordonné de systèmes sans pilote semblables, chargés d’effectuer une tâche commune, et qui se déplacent en restant en communication constante les uns avec les autres 5.

De la même façon qu’une voiture sans conducteur ressemble à une voiture ordinaire, les systèmes d’armes autonomes se distinguent des systèmes d’armes traditionnels plus par leur logiciel que par le matériel. Les véhicules aériens sans pilote (UAV ou drones aériens) et d’autres types de systèmes sans pilote qui sont téléguidés par un opérateur humain ne sont pas considérés comme des systèmes d’armes autonomes. Cela dit, de futurs progrès réalisés dans le domaine des logiciels pourront peut-être permettre aux systèmes sans pilote actuels de fonctionner en toute autonomie.

Les systèmes d’armes peuvent aussi être classés en fonction de leur degré d’autonomie. En général, les observateurs considèrent qu’il y a trois niveaux d’autonomie 6:

Ces niveaux d’autonomie ne sont pas immuables; l’opérateur humain peut commander au système d’armes de passer à un mode opératoire plus ou moins autonome, selon le contexte.

Beaucoup de systèmes d’armes avancés intègrent de plus en plus d’éléments d’autonomie, mais les experts ou les pays concernés ne parviennent pas à s’entendre pour dire avec certitude qu’il existe déjà un système d’armes complètement autonome 8.

Le gouvernement du Canada n’a pas adopté de définition officielle du terme « système d’armes autonome », mais le ministère de la Défense nationale (MDN) définit les systèmes autonomes comme des « systèmes ayant la capacité de composer et de choisir de façon indépendante parmi divers plans d’action pour atteindre des objectifs en fonction de son [information] et de sa compréhension du monde, de soi même (le système) et de la situation 9 ». Cette définition s’inspire de celle formulée par le Defense Science Board (conseil scientifique de la défense) des États-Unis en 2016.

La définition du terme « système d’armes autonome » varie d’un pays à l’autre. Aux États-Unis, par exemple, une directive du département de la Défense sur « l’autonomie des systèmes d’armes » parle d’un « système d’armes qui, une fois activé, peut sélectionner et attaquer une cible sans nécessiter d’autre intervention d’un opérateur humain 10 ».

Au Royaume-Uni, le ministère de la Défense définit les « systèmes d’armes complètement autonomes » comme des « machines capables de comprendre une intention de haut niveau et de décider d’un plan d’action sans avoir besoin de la surveillance et du contrôle d’un humain ». Il affirme également que de tels systèmes n’existent pas encore et qu’« il est peu probable qu’ils existent dans un avenir proche 11 ».

Pour sa part, dans sa définition du terme, la France renvoie à l’absence de supervision ou de contrôle humain à partir de l’activation, ainsi qu’à la capacité de s’affranchir du cadre de règles qu’un humain lui aura confiées et de s’assigner lui-même des objectifs. La France affirme que les systèmes d’armes létaux autonomes répondant à cette définition n’existent pas encore; à son avis, les véhicules aériens sans pilote et les missiles qui existent actuellement ne constituent pas des systèmes d’armes autonomes 12.

Les cyberarmes qui sélectionnent et attaquent des systèmes informatiques en fonction de certains critères, mais sans commandement explicite pourraient aussi être considérées comme des systèmes d’armes autonomes 13.

L’établissement éventuel d’une définition du terme « système d’armes autonome » acceptée dans le monde entier pourrait être compliqué par le manque d’uniformité entre les définitions utilisées dans différents pays et différentes organisations internationales.

Selon l’Institut international de recherche sur la paix de Stockholm, les pays qui ont un programme avéré de développement de systèmes d’armes possédant des éléments divers d’autonomie sont l’Allemagne, la Chine, la Corée du Sud, les États-Unis, la France, l’Inde, Israël, l’Italie, le Japon, le Royaume-Uni, la Russie et la Suède 14. Sur le plan mondial, les forces armées américaines font figure de chef de file dans le développement de l’autonomie pour un éventail d’applications, surtout depuis le lancement de la Defense Innovation Initiative (initiative d’innovation de la défense) en 2014. Cette initiative témoigne de la volonté des forces armées américaines de réaliser des progrès technologiques, notamment dans le domaine de l’autonomie, afin de maintenir leur avantage sur leurs ennemis potentiels 15.

Les systèmes d’armes actuels affichent des degrés d’autonomie divers. Par exemple, le « Harpy » est un véhicule aérien sans pilote autonome à utilisation unique développé par Israel Aerospace Industries 16. Une fois lancé, il survole un secteur prédéterminé et peut repérer et attaquer des systèmes radars ennemis sans avoir besoin d’une intervention humaine. C’est la raison pour laquelle ce système d’armes est appelé un système « autonome après tir ». Selon le centre d’étude du drone du Collège Bard, le Harpy a été vendu, entre autres, à l’Allemagne, à la Chine, à la Corée du Sud, à l’Inde et à la Turquie 17.

Le système « Super aEgis II », un fusil de sentinelle antipersonnel autonome qui a été développé par la firme sud coréenne DODAAM, peut identifier des cibles humaines et leur tirer dessus après avoir été orienté dans une direction précise. Après avoir sélectionné une cible en approche et lancé une série d’avertissements, le Super aEgis II demande à un opérateur humain d’entrer un mot de passe avant de faire feu. DODAAM a vendu le Super aEgis II au Qatar et aux Émirats arabes unis 18.

Notons enfin le missile guidé « Brimstone », développé pour la Royal Air Force britannique. Il peut être lancé à partir d’un avion de chasse ou, dans sa version « Sea Spear », d’un navire de guerre. Lorsqu’il est activé en mode autonome, le Brimstone prend pour cibles les véhicules qui se trouvent dans un petit secteur désigné. Il a été vendu à l’Arabie saoudite 19.

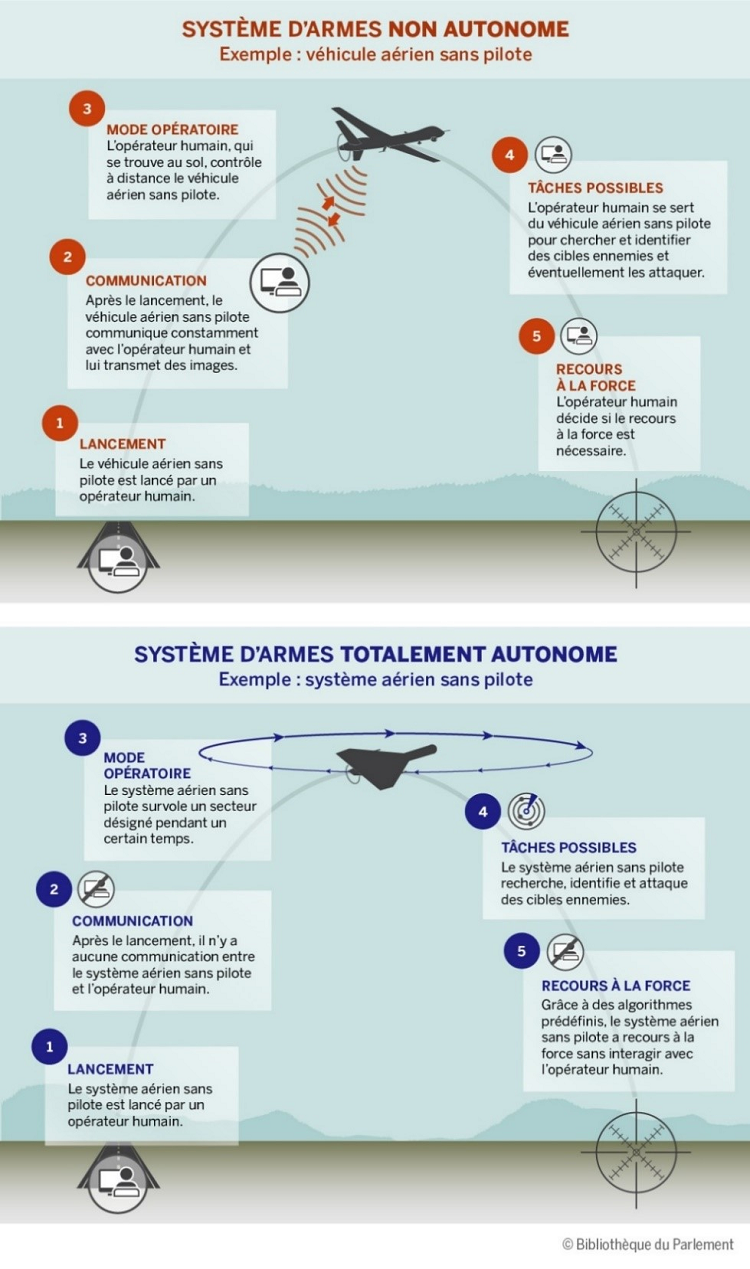

La figure 1 qui suit compare cinq aspects d’un système d’armes non autonome avec ceux d’un système d’armes complètement autonome.

Figure 1 – Comparaison d’un système d’armes non autonome avec un système d’armes complètement autonome

Source: Figure préparée par la Bibliothèque du Parlement à partir de données tirées de Paul Scharre, Army of None : Autonomous Weapons and the Future of War, New York, W.W. Norton and Company, 2018. L’illustration qui présente le système d’armes complètement autonome s’inspire du Harpy conçu par Israel Aerospace Industries.

Selon différents observateurs, les avantages potentiels liés au développement de systèmes d’armes autonomes relèvent généralement de trois catégories : avantages opérationnels (plus grande efficacité militaire); avantages économiques (allocation efficace des ressources); et avantages sur le plan humain (capacité des systèmes de réduire le nombre de victimes en cas de conflit).

Selon un rapport d’étude de l’Institut international de recherche sur la paix de Stockholm 20, les avantages opérationnels des systèmes d’armes autonomes comptent la rapidité – ils peuvent prendre des décisions plus vite qu’un opérateur humain – et l’agilité – ils n’ont pas besoin d’une communication constante avec l’opérateur humain pour fonctionner et peuvent donc s’adapter plus rapidement. Ils sont aussi capables d’une plus grande précision que l’opérateur humain et ont sans doute une endurance relativement plus élevée en raison des limitations cognitives et physiques de l’opérateur humain.

Par ailleurs, étant donné qu’ils n’ont pas à rester en communication avec un opérateur humain, les systèmes d’armes autonomes pourraient mieux convenir que les systèmes traditionnels pour les opérations en région éloignée, comme l’Arctique ou la haute mer. De plus, les avions militaires pourraient se servir de drones en essaim pour se protéger contre les missiles antiaériens.

Enfin, d’après Michael C. Horowitz, de l’Université de la Pennsylvanie, les systèmes d’armes autonomes pourraient aider les militaires à mener des opérations plus profondément en territoire ennemi. Une telle capacité pourrait permettre de réduire les pertes humaines et les besoins en réseaux d’approvisionnement et de communication 21.

Même s’ils entraînent initialement des dépenses importantes en recherche et développement, les systèmes d’armes autonomes peuvent offrir des avantages économiques en réduisant de diverses manières le coût des opérations militaires.

Par exemple, l’utilisation de ces systèmes peut permettre d’accomplir une tâche avec moins de personnel. Les forces armées sont ainsi capables d’affecter du personnel et d’autres ressources à des fonctions plus complexes plutôt qu’à des tâches « monotones, sales ou dangereuses 22 ».

Les systèmes d’armes autonomes ont aussi le potentiel de faire diminuer les coûts de personnel, comme l’a souligné David Francis, du Fiscal Times. En 2013, l’entretien d’un seul soldat en Afghanistan (équipement compris) coûtait annuellement 850 000 $ US au département américain de la Défense; la même année, un petit robot armé coûtait 230 000 $ US 23.

Comme leur utilisation pourrait réduire le nombre de victimes en cas de conflit, les systèmes d’armes autonomes ont potentiellement des avantages sur le plan humain. Par exemple, les forces armées pourraient remplacer des avions de chasse avec pilote par des systèmes de ce genre, ce qui éliminerait ainsi le risque pour leurs pilotes 24. Certains observateurs évoquent par ailleurs des exemples d’erreurs et d’atrocités commises dans des guerres passées pour faire valoir que les systèmes d’armes autonomes pourraient réduire le nombre de pertes civiles 25. En effet, ces systèmes n’attaqueraient pas par peur, colère ou esprit de vengeance, et ne feraient pas d’erreur de calcul à cause du stress ou de la fatigue.

Dans un mémoire présenté en 2018 au Groupe d’experts gouvernementaux des Nations Unies, les États-Unis ont soutenu que les systèmes d’armes autonomes peuvent réduire les pertes de vie : « Les fonctions automatisées d’identification, de localisation, de sélection et d’attaque de cibles peuvent permettre aux armes de frapper des objectifs militaires avec plus de précision et moins de risques de dommages collatéraux 26 ».

Les systèmes d’armes autonomes ont certes des avantages potentiels sur les plans opérationnel, économique et humain, mais leur développement et leur utilisation suscitent certaines préoccupations. Parmi celles ci, notons la possibilité que ces systèmes aient un effet déstabilisateur sur la paix et la sécurité, les problèmes humanitaires que leur utilisation pourrait entraîner et le risque de défaillance de ces systèmes.

Par le passé, certains types de systèmes d’armes ont eu un effet déstabilisateur plus important que d’autres sur les relations internationales. Paul Scharre, agrégé supérieur de recherches au Center for a New American Security, estime que l’autonomie profite tant aux systèmes d’attaque que de défense, et que de nombreux pays utilisent déjà des systèmes d’armes autonomes supervisés pour leur défense. Cela dit, selon lui, c’est dans le cadre d’une offensive que les systèmes d’armes complètement autonomes semblent s’avérer les plus utiles 27. Certains observateurs croient qu’un État disposant de systèmes d’armes autonomes pourrait être tenté de frapper le premier, ce qui risque d’accroître la probabilité de déclenchement de conflits et la gravité de ceux-ci 28. Par exemple, un État qui envisage de frapper une cible étrangère peut être plus susceptible de passer à l’action s’il possède des véhicules aériens sans pilote autonomes, car il ne risque alors pas de perdre de pilote 29.

Les systèmes d’armes autonomes pourraient aussi s’avérer des moyens efficaces de cibler et de détruire des armes nucléaires et leurs véhicules de lancement. Ils risquent donc de mettre en péril la stabilité maintenue grâce à la dissuasion nucléaire 30.

Par ailleurs, comme les systèmes d’armes autonomes sont de plus en plus petits et de moins en moins chers à produire, ils pourraient finir par être à la portée d’organisations terroristes 31. Par exemple, Daech – aussi appelé État islamique en Iraq et en Syrie, EIIS, EIIL ou État islamique – s’est servi de drones téléguidés vendus sur le marché pour lancer des grenades sur les forces armées américaines en Iraq 32. Daech ou d’autres organisations terroristes pourraient aussi employer des systèmes d’armes autonomes si la technologie devient moins chère.

Le secrétaire général des Nations Unies, António Guterres, a décrit les systèmes d’armes autonomes comme étant « moralement répugnants ». Comme d’autres, il juge inacceptable qu’on laisse une machine déterminer qui vit et qui meurt 33.

Dans son rapport de 2018 concernant les systèmes d’armes autonomes, Human Rights Watch a fait valoir que de tels systèmes sont fondamentalement illégaux au regard du droit international, car ils contreviennent à la « clause de Martens » contenue dans les protocoles de 1977 des Conventions de Genève 34. Cette clause prévoit que, dans les situations qui ne sont pas explicitement traitées par le droit international, les populations civiles et les combattants « restent sous la sauvegarde et sous l’empire des principes du droit des gens […], des principes de l’humanité et des exigences de la conscience publique 35 ». Étant donné qu’un système d’armes autonome n’est pas humain, il est incapable de se conformer aux principes de l’humanité (éthique, justice, dignité, respect et empathie, entre autres choses). Il pourrait également être difficile de mettre au point un système d’armes autonome qui respecte le droit international en temps de guerre, comme l’interdiction d’attaquer des soldats qui se rendent 36.

S’exprimant en son propre nom, Daniel Sukman, major de l’armée américaine, a suggéré que, si la majorité des opérations militaires américaines à l’étranger étaient menées à l’aide de systèmes d’armes autonomes, les ennemis des États-Unis pourraient conclure qu’il est plus avantageux de s’en prendre directement aux États-Unis plutôt qu’aux forces américaines déployées à l’étranger. Ainsi, un ennemi pourrait détruire les centres de commandement des réseaux de systèmes. De même, si des ennemis s’en prennent à des cibles aux États-Unis, plutôt qu’à l’étranger, la population américaine pourrait s’opposer davantage au conflit 37.

Enfin, si un drone de type « autonome après tir » détruisait un immeuble civil plutôt qu’une installation militaire, il pourrait être impossible de déterminer exactement qui est responsable et qui doit en subir les conséquences.

Même si les systèmes d’armes autonomes pourraient réduire les pertes de vie et les accidents, aucun système d’armes n’est à l’abri d’une défaillance. Rien ne permet de croire qu’un système d’armes autonome aura plus ou moins de défaillances qu’un système d’armes non autonome. Cependant, les systèmes autonomes sont susceptibles d’avoir des défaillances différentes de celles des systèmes non autonomes. Il peut être difficile de prévoir ce qu’un système d’armes autonome fera et de déterminer s’il a eu en effet une défaillance et pour quelle raison 38.

Les systèmes d’armes autonomes reposent sur l’intelligence artificielle qui, au moins aux premières étapes de son développement, dépend des décisions prises par des humains. Ces décisions et les préjugés inhérents influent sur les algorithmes qui, par exemple, pourraient servir à choisir les cibles en cas de conflit et à prendre la décision qu’une personne vit ou meurt 39. Erin Hunt, de l’organisme Mines Action Canada, est d’avis que les systèmes d’armes autonomes pourraient prendre des décisions fondées sur des préjugés, ce qui aurait, selon elle, des conséquences graves 40.

Selon Stephanie Carvin, de l’Université Carleton, en raison de la complexité unique et sans précédent des systèmes d’armes autonomes, les « accidents normaux » (c. à d. ceux qui surviennent non pas à cause d’un unique défaut de conception fatal, mais à cause de l’interaction d’éléments complexes dans des circonstances imprévues) deviennent de plus en plus probables 41. Même si ces systèmes sont testés rigoureusement, il est impossible de les tester dans toutes les situations dans lesquelles ils pourraient se retrouver.

Qui plus est, un système d’armes autonome pourrait ne pas détecter sa propre défaillance. Les opérateurs humains qui commettent une erreur, par exemple en tirant sur des alliés, peuvent reconnaître immédiatement qu’ils ont commis une erreur et modifier leur plan d’action. Cependant, un système d’armes autonome qui connaît une défaillance en agissant d’une certaine façon pourrait fort probablement continuer à fonctionner de la même façon et répéter la même erreur jusqu’à ce qu’il soit détruit ou reprogrammé.

En raison du potentiel de défaillance des systèmes d’armes autonomes, les ennemis pourraient être tentés de provoquer des défaillances, notamment en exploitant les vulnérabilités des systèmes. Comme l’a expliqué Paul Scharre, « une fois qu’un adversaire découvre une vulnérabilité dans un système autonome, il est libre de l’exploiter jusqu’à ce qu’un humain découvre la vulnérabilité et apporte un correctif au système ou modifie son utilisation. Le système lui-même ne peut pas s’adapter 42. »

Un système d’armes autonomes peut donc connaître des défaillances qu’un humain ne pourrait pas connaître et peut causer involontairement des morts ou des dommages sérieux. De telles défaillances pourraient, de plus, être jugées inacceptables par la société. Cependant, un système de ce genre pourrait en même temps provoquer, en moyenne, relativement moins de décès involontaires et moins de dommages qu’un système dépendant d’un opérateur humain, et s’avérer ainsi plus efficace.

Divers groupes militent pour une interdiction complète ou partielle des systèmes d’armes autonomes. En 2016, les Hautes Parties contractantes à la Convention sur certaines armes classiques (dont fait partie le Canada) ont établi le Groupe d’experts gouvernementaux (GEG) sur les systèmes d’armes létaux autonomes. Sous l’égide des Nations Unies, le GEG sert de tribune où les États, les universitaires et les organisations non gouvernementales peuvent discuter de pratiques exemplaires et recommander à la communauté internationale des façons d’aborder les technologies militaires émergentes, y compris les systèmes d’armes autonomes 43. La dernière réunion du GEG a eu lieu en août 2019 44 et les Hautes Parties contractantes se sont rencontrées en novembre 2019. Selon les médias, aucun progrès substantiel n’a été accompli à la réunion de novembre 2019 pour l’interdiction de ces systèmes 45.

Selon la Campaign to Stop Killer Robots (Campagne pour stopper les robots tueurs), en date d’octobre 2019, 29 gouvernements réclamaient que l’on interdise dans le droit international la création et l’utilisation de systèmes d’armes complètement autonomes. Un seul gouvernement, celui de la Chine, a appuyé l’interdiction visant leur utilisation, mais pas leur création 46. Même si le premier ministre du Canada a indiqué en décembre 2019 que le Canada s’efforcerait d’obtenir une telle interdiction, le gouvernement du Canada n’a toujours pas publié de déclaration officielle pour appuyer l’interdiction et ne figure pas parmi les 29 gouvernements susmentionnés. Jusqu’à maintenant, d’autres gouvernements (dont l’Allemagne, l’Australie, les États-Unis, la France, le Royaume-Uni et la Russie) s’opposent aux tentatives d’interdire les systèmes d’armes autonomes 47.

Parmi les pays qui s’opposent à l’interdiction des systèmes d’armes autonomes, certains ont décidé malgré tout de s’imposer des limites quant à leur création. Par exemple, au moyen de la directive 3000.09 du département de la Défense, les États-Unis exigent que tout système autonome soit conçu de façon à permettre aux commandants et aux opérateurs d’exercer leur jugement quant au recours à la force 48. De plus, en octobre 2019, le Defense Innovation Board créé par le secrétaire américain à la Défense a publié un rapport qui recommande cinq principes à appliquer pour l’utilisation de l’intelligence artificielle par l’armée américaine, dont la responsabilité humaine ainsi que l’absence de préjugés et de blessures involontaires 49. De même, la ministre française des Armées a déclaré que la France refuse qu’une machine qui fonctionne sans contrôle humain puisse prendre des décisions quant à la vie ou à la mort d’individus 50.

Paul Scharre relève plusieurs facteurs qui, à son avis, compliquent les efforts visant à interdire les systèmes d’armes autonomes. Il s’agit notamment de l’évolution constante de la technologie concernée, de l’absence d’une définition commune de ces systèmes et de la difficulté de vérifier la conformité à une interdiction internationale. Il signale par ailleurs des mesures que la communauté internationale pourrait prendre pour remplacer une interdiction complète de ces systèmes, notamment interdire uniquement les systèmes d’armes autonomes antipersonnel ou un accord international sur le principe général concernant le rôle du jugement humain dans les conflits armés 51.

Le Canada est à l’avant-garde en matière de recherche civile sur l’intelligence artificielle 52, mais le pays ne semble pas développer de systèmes d’armes autonomes. Cela étant dit, par l’entremise de Recherche et développement pour la défense Canada, le MDN effectue des recherches sur l’autonomie et l’intelligence artificielle appliquées à la défense. En 2018, par exemple, le MDN a sollicité des propositions des secteurs privé et universitaire pour l’aider dans le cadre d’une étude visant « à promouvoir les avancées révolutionnaires dans notre compréhension des applications des systèmes autonomes en défense et en sécurité 53 ».

Le gouvernement du Canada note que « [l]es Forces armées canadiennes s’engagent à maintenir un contrôle convenable de la part de l’être humain sur l’utilisation de capacités militaires pouvant appliquer une force létale 54 ». À l’Assemblée générale des Nations Unies en 2017, le Canada a déclaré qu’une « compréhension approfondie 55 » des systèmes d’armes létaux autonomes était nécessaire dans le contexte de la Convention sur certaines armes classiques.

En décembre 2019, dans sa lettre de mandat au ministre des Affaires étrangères, le premier ministre du Canada a instruit celui ci de « [f]aire progresser les efforts internationaux en vue d’interdire le développement et l’utilisation de systèmes d’armes entièrement autonomes 56 ». Avant décembre 2019, le gouvernement du Canada n’avait pas fait part de sa position sur une interdiction éventuelle de tels systèmes et, en mai 2018, il avait déclaré qu’une telle interdiction serait prématurée étant donné que la technologie n’existe pas actuellement 57. L’appui du Canada à l’interdiction des systèmes d’armes autonomes va à contre-courant des positions adoptées par certains de ses alliés, y compris les États-Unis, la France et le Royaume-Uni 58.

Malgré l’intention du gouvernement du Canada de faire progresser les efforts en vue d’interdire les systèmes d’armes autonomes à l’échelle internationale, les Forces armées canadiennes pourraient un jour faire face à des adversaires qui ont mis au point de tels systèmes. Étant donné que les systèmes d’armes autonomes peuvent prendre des décisions beaucoup plus rapidement que les humains et peuvent fonctionner sans se reposer et se ravitailler, contrairement aux soldats humains, les Forces armées canadiennes devront s’adapter à ces nouvelles circonstances si elles se retrouvent face à de tels adversaires 59.

Partout dans le monde, la recherche se poursuit sur l’autonomie des systèmes miliaires. Les percées technologiques rapides dans ce domaine font en sorte que les progrès potentiels pourraient devancer l’évolution de la doctrine militaire 60, de la diplomatie, de la prise de décisions politiques et de la jurisprudence.

Un consensus semble se dessiner que, dans la plupart des cas, il est nécessaire d’avoir un certain degré de contrôle humain avant que la machine ne puisse exercer une force létale. On semble aussi convenir que divers éléments du droit international doivent s’appliquer à l’utilisation de tous les systèmes d’armes, y compris de ceux qui bénéficient d’un certain degré d’autonomie 61. Cependant, il n’existe pas de consensus quant à savoir si ces principes devraient être repris dans le droit international et, si tel est le cas, de quelle façon.

Enfin, en dépit de tous les efforts pour anticiper les progrès réalisés dans ce domaine, il pourrait ne pas être facile d’évaluer les capacités des systèmes d’armes autonomes, la probabilité qu’ils connaissent une défaillance et la façon dont ils vont sans aucun doute modifier les relations internationales, et ce, jusqu’à ce que ce type de systèmes d’armes soient employés pendant une crise ou une situation conflictuelle.

† Les documents de la série En bref de la Bibliothèque du Parlement sont des survols de sujets d’actualité. Dans certains cas, ils donnent un aperçu de la question et renvoient le lecteur à des documents plus approfondis. Ils sont préparés par le Service d’information et de recherche parlementaires de la Bibliothèque, qui effectue des recherches et fournit des informations et des analyses aux parlementaires, ainsi qu’aux comités du Sénat et de la Chambre des communes et aux associations parlementaires, et ce, de façon objective et impartiale. [ Retour au texte ]

© Bibliothèque du Parlement